1、概述

上篇文章《架构设计:负载均衡层设计方案(6)——Nginx + Keepalived 构建高可用的负载层》(http://blog.csdn.net/yinwenjie/article/details/47130609) 我们讲解了 Nginx 的故障切换,并且承诺各位读者会尽快讲解 LVS + Keepalived + Nginx 的安装和配置。在中间由于工作的原因,我又插写了三篇关于 zookeeper 的原理使用的文章。今天这边文章我们回归主题,为各位读者讲解 LVS + Keepalived + Nginx 的安装及配置。

2、安装计划和准备工作

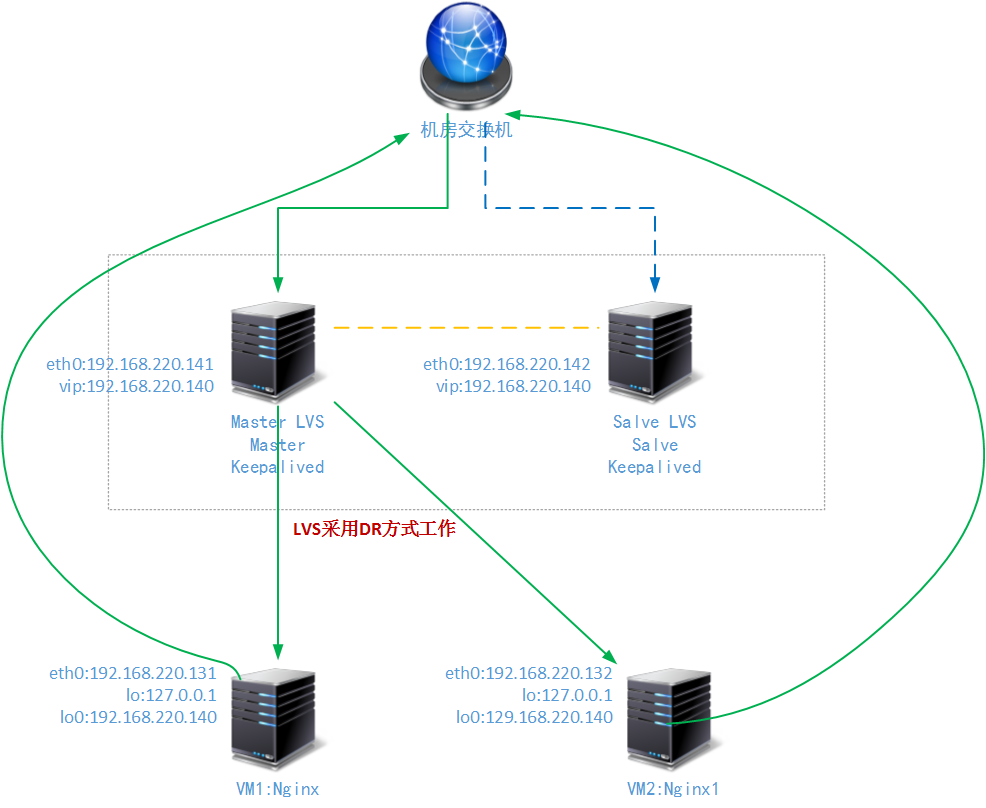

下图,我们表示了本篇文章要搭建的整个集成架构的抽象结构:

我们采用两个 LVS 节点(141 和 142),但是一个时间工作的只有一个 LVS 节点,另一个始终处于热备 standby 状态,由 keepalived 监控这两个节点的工作状态并完成切换。

在 LVS 节点下,我们采用 LVS-DR 工作模式挂载了两个 Nginx 节点(131、132)。并最终将外网请求交由这两个节点进行处理。注意:在实际工作中,Nginx 下面一般就是访问静态资源、动态资源的配置了。

2-1、准备两个 keepalived 节点

首先我们在将要安装 LVS 的两个节点上,先安装 keepalived,并保证这两个 keepalived 节点能够正常工作(监控批次的状态)。当然,您也可以先准备 LVS,在准备 keepalived。

我想准备 keepalived 节点,大家应该轻车熟路了吧,在《架构设计:负载均衡层设计方案(6)——Nginx + Keepalived 构建高可用的负载层》这篇文章中详细介绍了 keepalived 的最简配置方式。为了大家阅读方便,我们在这里再进行依次简要说明。准备 keepalived 的整个过程包括:

- 安装必要的支撑组件,源码安装 keepalived

- 将 keepalived 注册成节点的服务,以便保证 keepalived 在节点启动时就开始工作

- 更改 keepalived 的配置文件,让其可以正常工作

- 验证准备工作

============= 安装 keepalived

[root@lvs1 ~]# yum install -y zlib zlib-devel gcc gcc-c++ openssl openssl-devel openssh

[root@lvs1 ~]# tar -zxvf keepalived-1.2.17.tar.gz

[root@lvs1 ~]# cd keepalived-1.2.17

[root@lvs1 ~]# ./configure --perfix=/usr/keepalived-1.2.17

[root@lvs1 ~]# make & make install

============= 将 keepalived 注册成服务(如果您使用的默认路径安装,就不需要 cp 命令了)

[root@lvs1 ~]# cp /usr/keepalived-1.2.17/etc/sysconfig/keepalived /etc/sysconfig/keepalived

[root@lvs1 ~]# cp /usr/keepalived-1.2.17/sbin/keepalived /usr/sbin/keepalived

[root@lvs1 ~]# cp /usr/keepalived-1.2.17/etc/rc.d/init.d/keepalived /etc/rc.d/init.d/keepalived

[root@lvs1 ~]# mkdir /etc/keepalived

[root@lvs1 ~]# cp /usr/keepalived-1.2.17/etc/keepalived/keepalived.conf /etc/keepalived/keepalived.conf

[root@lvs1 ~]# 可以做成服务了(不要拷贝,没用的)

[root@lvs1 ~]# chkconfig keepalived on

做成服务后,先不要急着启动,因为配置文件还没有改好。

======== 配置 keepalived(配置文件在:/etc/keepalived/keepalived.conf)

! Configuration File for keepalived

global_defs {

#notification_email {

# acassen@firewall.loc

# failover@firewall.loc

# sysadmin@firewall.loc

#}

#notification_email_from Alexandre.Cassen@firewall.loc

#smtp_server 192.168.200.1

#smtp_connect_timeout 30

router_id LVS_DEVEL

}

vrrp_instance VI_1 {

#141节点设置为MASTER,142或者还有其他的节点设置为BACKUP

#还记得我们前面文章讲到的无抢占设置吗?这里也可以用哦。

state MASTER

#网络适配器名称

interface eth0

virtual_router_id 51

#所有的SLAVE节点的优先级都要比这个设置值低

priority 120

advert_int 1

#真实ip,142要改成相应的lvs节点真实ip

mcast_src_ip=192.168.220.141

authentication {

auth_type PASS

auth_pass 1111

}

#虚拟/浮动IP

virtual_ipaddress {

192.168.220.140

}

}

以上配置还是最简单的 keepalived 配置,因为我们还没有加上配合 LVS 使用的虚拟 ip 监测设置和下层真实 ip 监测的设置。最简配置主要是为了保证 keepalived 节点是工作正常的。

将以上的配置分别对应到 LVS 的两个节点(注意要改动的地方哦)

========== 进行 keepalived 工作状态的检查:

[root@lvs1 ~]# /etc/init.d/keepalived start

现在设置为 MASTER 的 keepalived 节点(或者在非抢占模式下,优先级最高的那个节点),已经绑定了 140 这个虚拟 ip 了:

[root@lvs2 ~]# ip addr

1: lo: <LOOPBACK,UP,LOWER_UP> mtu 16436 qdisc noqueue state UNKNOWN

link/loopback 00:00:00:00:00:00 brd 00:00:00:00:00:00

inet 127.0.0.1/8 scope host lo

inet6 ::1/128 scope host

valid_lft forever preferred_lft forever

2: eth0: <BROADCAST,MULTICAST,UP,LOWER_UP> mtu 1500 qdisc pfifo_fast state UP qlen 1000

link/ether 00:0c:29:39:75:9f brd ff:ff:ff:ff:ff:ff

inet 192.168.220.141/24 brd 192.168.220.255 scope global eth0

inet 192.168.220.140/32 scope global eth0

inet6 fe80::20c:29ff:fe39:759f/64 scope link

valid_lft forever preferred_lft forever

当然您也可以通过 /var/log/message 的日志进行 keepalived 是否正常工作的验证。

2-2、继续两个 keepalived 节点上准备 LVS

准备 lvs 的工作就太简单了,因为 centos6.4、6.5、6.6 都已经集成了 LVS 的核心,我们只需要安装 LVS 的管理工具就行了:

两个 LVS 节点都执行:

yum -y install ipvsadm

还记得 lvs 管理工具怎么使用吗?请参见我介绍 LVS 单节点安装的博文:《架构设计:负载均衡层设计方案(5)——LVS 单节点安装》。这里为了方便阅读,给出主要参数的含义列表:

-A –add-service 在内核的虚拟服务器表中添加一条新的虚拟服务器记录。也就是增加一台新的虚拟服务器。

-E –edit-service 编辑内核虚拟服务器表中的一条虚拟服务器记录。

-D –delete-service 删除内核虚拟服务器表中的一条虚拟服务器记录。

-C –clear 清除内核虚拟服务器表中的所有记录。

-R –restore 恢复虚拟服务器规则

-S –save 保存虚拟服务器规则,输出为-R 选项可读的格式

-a –add-server 在内核虚拟服务器表的一条记录里添加一条新的真实服务器记录。也就是在一个虚拟服务器中增加一台新的真实服务器

-e –edit-server 编辑一条虚拟服务器记录中的某条真实服务器记录

-d –delete-server 删除一条虚拟服务器记录中的某条真实服务器记录

-L –list 显示内核虚拟服务器表

-Z –zero 虚拟服务表计数器清零(清空当前的连接数量等)

–set tcp tcpfin udp 设置连接超时值

–start-daemon 启动同步守护进程。他后面可以是master 或backup,用来说明LVS Router 是master 或是backup。在这个功能上也可以采用keepalived 的VRRP 功能。

–stop-daemon 停止同步守护进程

-t –tcp-service service-address 说明虚拟服务器提供的是tcp 的服务[vip:port] or [real-server-ip:port]

-u –udp-service service-address 说明虚拟服务器提供的是udp 的服务[vip:port] or [real-server-ip:port]

-f –fwmark-service fwmark 说明是经过iptables 标记过的服务类型。

-s –scheduler scheduler 使用的调度算法,选项:rr|wrr|lc|wlc|lblc|lblcr|dh|sh|sed|nq, 默认的调度算法是: wlc.

-p –persistent [timeout] 持久稳固的服务。这个选项的意思是来自同一个客户的多次请求,将被同一台真实的服务器处理。timeout 的默认值为300 秒。

-M –netmask netmask persistent granularity mask

-r –real-server server-address 真实的服务器[Real-Server:port]

-g –gatewaying 指定LVS 的工作模式为直接路由模式DR模式(也是LVS默认的模式)

-i –ipip 指定LVS 的工作模式为隧道模式

-m –masquerading 指定LVS 的工作模式为NAT 模式

-w –weight weight 真实服务器的权值

–mcast-interface interface 指定组播的同步接口

–connection 显示LVS 目前的连接 如:ipvsadm -L -c

–timeout 显示tcp tcpfin udp 的timeout 值 如:ipvsadm -L –timeout

–daemon 显示同步守护进程状态

–stats 显示统计信息

–rate 显示速率信息

–sort 对虚拟服务器和真实服务器排序输出

–numeric -n 输出IP 地址和端口的数字形式

到后面正式启动 LVS 的时候,就不要问我参数含义咯。_^

2-3、准备两个 Nginx 节点并保证可用

在《架构设计:负载均衡层设计方案(5)——LVS 单节点安装》(http://blog.csdn.net/yinwenjie/article/details/47010569) 这篇文章中,我们详细讲解了 Nginx 节点的准备工作,但是为了方便各位读者阅读,这里我们大致再讲一下。

Nginx 节点的准备工作主要由以下步骤构成(这个不是本文的重点,点到即可):

- 安装 Nginx(当然,正式系统中,还涉及到 Nginx 的参数调优,可以参见《架构设计:负载均衡层设计方案(2)——Nginx 安装》这篇文章)

- 打开 Nginx 所在服务器的 “路由” 功能、关闭 “ARP 查询” 功能

- 将 VIP:192.168.220.140 设置成 Nginx 所在节点的回环 IP

============= 安装 Nginx

[root@vm1 ~]# yum -y install make zlib zlib-devel gcc gcc-c++ ssh libtool

[root@vm1 ~]# 下载nginx(别拷贝,不能执行的)

[root@vm1 ~]# 解压nginx(别拷贝,不能执行的)

[root@vm1 ~]# ./configure –prefix=/usr/nginx-1.8.0

[root@vm1 ~]# make && make install

[root@vm1 ~]# 设置环境变量(别拷贝,不能执行的)

[root@vm1 ~]# 启动nginx

============= 打开 Nginx 所在服务器的 “路由” 功能、关闭 “ARP 查询” 功能

[root@vm1 ~]# echo "1" >/proc/sys/net/ipv4/conf/lo/arp_ignore

[root@vm1 ~]# echo "2" >/proc/sys/net/ipv4/conf/lo/arp_announce

[root@vm1 ~]# echo "1" >/proc/sys/net/ipv4/conf/all/arp_ignore

[root@vm1 ~]# echo "2" >/proc/sys/net/ipv4/conf/all/arp_announce

============= 设置回环 IP

[root@vm1 ~]# ifconfig lo:0 192.168.220.140 broadcast 192.168.220.140 netmask 255.255.255.255 up

[root@vm1 ~]# route add -host 192.168.220.140 dev lo:0

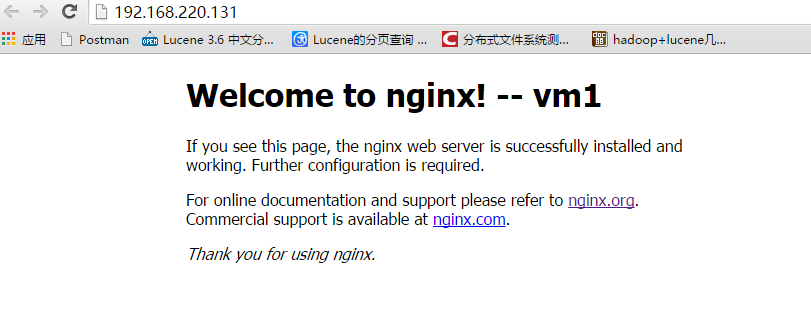

两台 Nginx 的节点都按照这样的方法去设置。然后使用浏览器,看看这两个节点的 Nginx 是否工作正常:

2-4、其他说明

keepalived 和 LVS 是天生配合完美的一对,LVS 负责进行请求转发不负责任何节点的健康监测;keepalived 负责监控整个环境中,包括虚拟 ip,真实 ip 对应的下层节点的健康状态监测。

3、开始配置:LVS-DR 工作模式

3-1、keepalived 的更改——健康监测

首先我们要更改之前配置的 “最简 keepalived” 配置,让 keepalived 能够对结构中所有节点和虚拟 ip 的健康状态进行监测。更改配置和含义如下:

! Configuration File for keepalived

global_defs {

#notification_email {

# acassen@firewall.loc

# failover@firewall.loc

# sysadmin@firewall.loc

#}

#notification_email_from Alexandre.Cassen@firewall.loc

#smtp_server 192.168.200.1

#smtp_connect_timeout 30

router_id LVS_DEVEL

}

vrrp_instance VI_1 {

#141节点设置为MASTER,142或者还有其他的节点设置为BACKUP

#还记得我们前面文章讲到的无抢占设置吗?这里也可以用哦。

state MASTER

#网络适配器名称

interface eth0

virtual_router_id 51

#所有的SLAVE节点的优先级都要比这个设置值低

priority 120

advert_int 1

#真实ip,142要改成相应的lvs节点真实ip

mcast_src_ip=192.168.220.141

authentication {

auth_type PASS

auth_pass 1111

}

#虚拟/浮动IP

virtual_ipaddress {

192.168.220.140

}

}

virtual_server 192.168.220.140 80 {

#健康时间检查,单位秒

delay_loop 6

#负载均衡调度算法wlc|rr,和您将使用的LVS的调度算法保持原则一致

lb_algo rr

#负载均衡转发规则 DR NAT TUN。和您将启动的LVS的工作模式设置一致

lb_kind DR

#虚拟地址的子网掩码

nat_mask 255.255.255.0

#会话保持时间,因为我们经常使用的是无状态的集群架构,所以这个设置可有可无

#persistence_timeout 50

#转发协议,当然是TCP

protocol TCP

#真实的下层Nginx节点的健康监测

real_server 192.168.220.131 80 {

#节点权重,

weight 10

#设置检查方式,可以设置HTTP_GET | SSL_GET

HTTP_GET {

url {

path /

digest ff20ad2481f97b1754ef3e12ecd3a9cc

}

#超时时间,秒。如果在这个时间内没有返回,则说明一次监测失败

connect_timeout 3

#设置多少次监测失败,就认为这个真实节点死掉了

nb_get_retry 3

#重试间隔

delay_before_retry 3

}

}

real_server 192.168.220.132 80 {

weight 10

HTTP_GET {

url {

path /

digest 640205b7b0fc66c1ea91c463fac6334d

}

connect_timeout 3

nb_get_retry 3

delay_before_retry 3

}

}

}

这样一来,keepalived 就可以检查整个架构中的所有节点状态了。另外要说明的是,这个检查过程并不是必须的,您使用 keepalived 的最简配置也是可以的,不过您就需要自己写监测脚本了(道理是一样的)。

3-2、启动两个 LVS 节点

启动 LVS 的过程就太简单了(两个节点都是一样的启动方式):

[root@lvs2 ~]# ipvsadm -C

[root@lvs2 ~]# ipvsadm -At 192.168.220.140:80 -s rr

[root@lvs2 ~]# ipvsadm -at 192.168.220.140:80 -r 192.168.220.131 -g

[root@lvs2 ~]# ipvsadm -at 192.168.220.140:80 -r 192.168.220.132 -g

[root@lvs2 ~]# 然后我们可以使用ipvsadm 监控目前LVS的状态

[root@lvs2 ~]# ipvsadm

注意:处于 standby 的 lvs1 节点也要这样进行设置。

还有,以上的 LVS 的设置,和 real server 上的设置,在重启后都会消失,所以一定要做成脚本哦。

4、验证工作

这样 LVS + Keepalived + Nginx 方式的配置就做完了。现在我们进行搭建效果的监测:

4-1、验证 Master-LVS 节点的工作

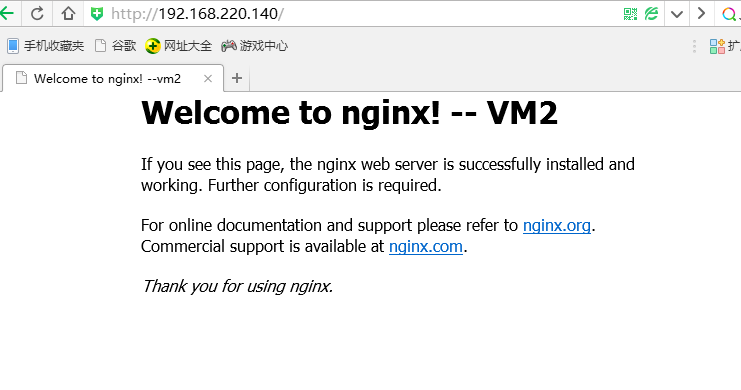

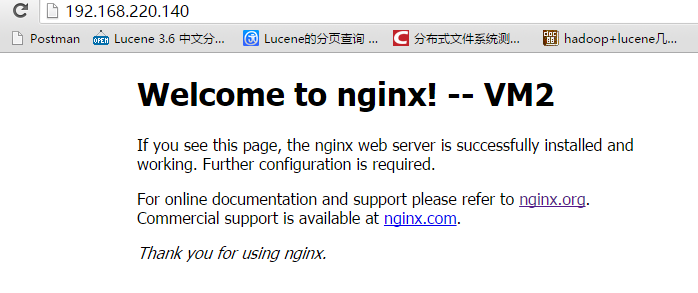

我们使用两个不同的浏览器,验证 Master-LVS 节点的工作:

========= 浏览器 1:

========= 浏览器 2:

看来 140 这个 VIP 下的 LVS 工作是正常的。

4-2、验证 Master-LVS 节点停止后的效果

下面我们停止 Master-LVS1:

[root@lvs2 ~]# service keepalived stop

在经历了一些访问停顿后,浏览器 1 显示的效果如下(这就是为什么 keepalived 最好设置为非抢占模式):

5、后文介绍

好了,到这里负载均衡层所使用的几个标准工具就介绍完了。下一篇文章我们将进行总结,然后进入架构设计:业务层设计方案 的系列文章。在下一个系列文章中,我们将介绍至少两套 SOA 的实现、至少两套系统间通信使用的消息队列。哦,应我朋友的要求,我会专门写几篇文章,介绍 java 中线程的基础知识和进阶知识。